A Evolução do Risco de Injeção de Prompt em Sistemas de IA

A Evolução do Risco de Injeção de Prompt em Sistemas de IA

aitech.pt

aitech.pt

AI Prompt Injection Risks Highlighted

A crescente complexidade e autonomia das ferramentas de Inteligência Artificial (IA) levanta preocupações significativas sobre a segurança dos sistemas em que são integradas. Uma das vulnerabilidades críticas emergentes é a injeção de prompt, uma técnica que permite a um atacante manipular o comportamento de sistemas de IA ao embutir instruções maliciosas dentro de conteúdos aparentemente benignos. Este artigo examina os riscos associados à injeção de prompt, fornecendo uma compreensão profunda do seu funcionamento, tipos de ataques, danos potenciais e estratégias de mitigação.

Como Funciona a Injeção de Prompt

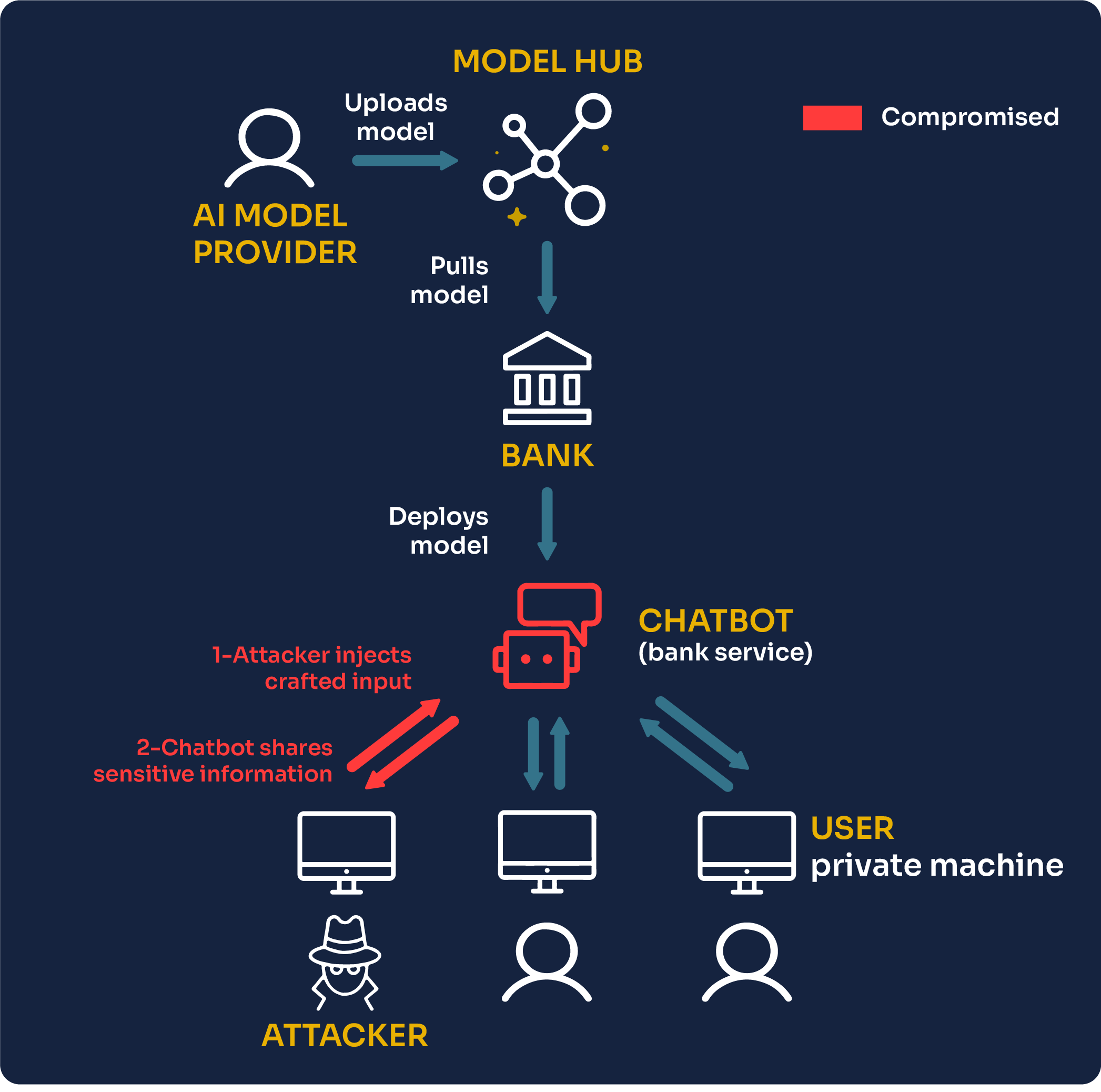

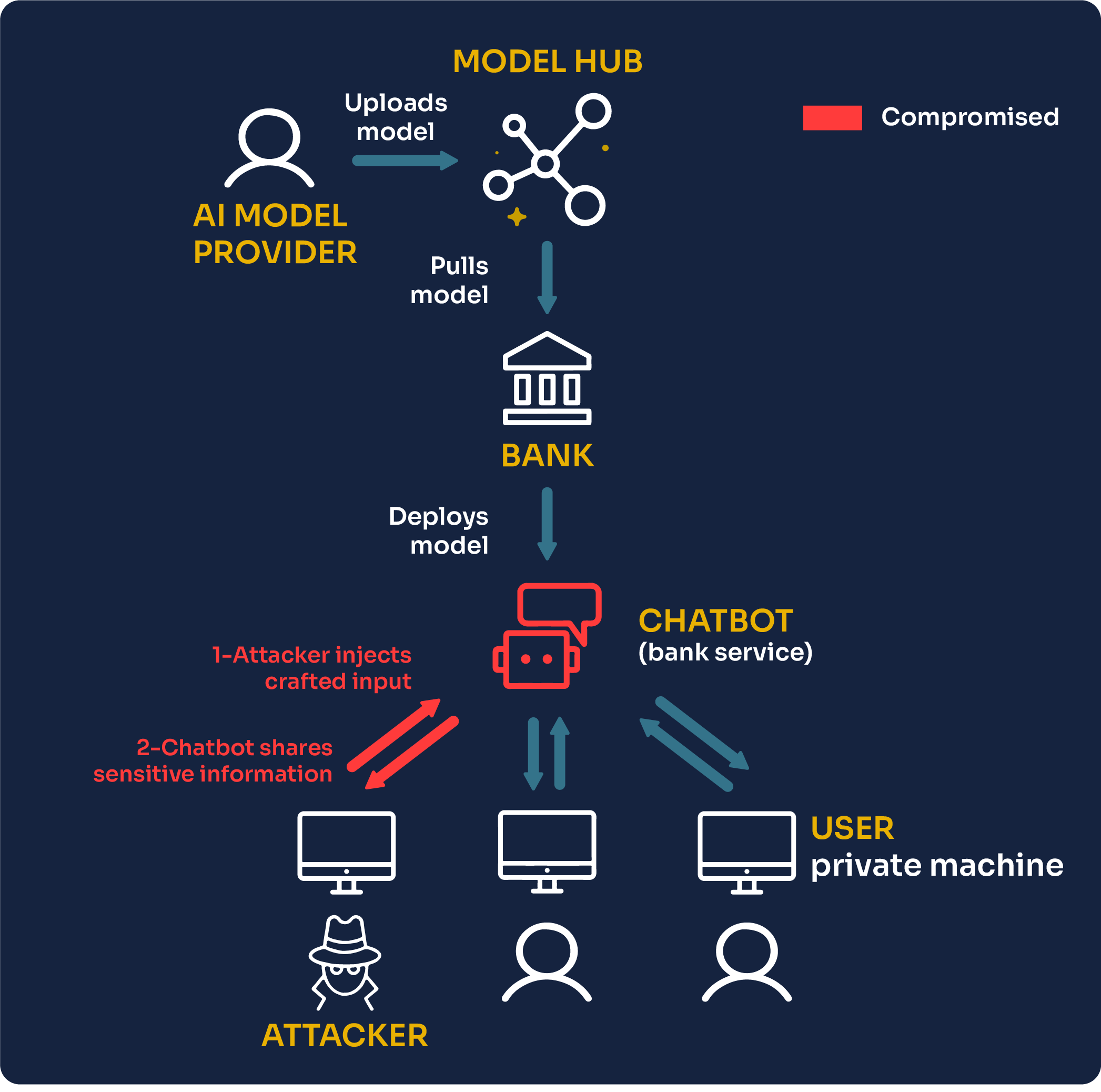

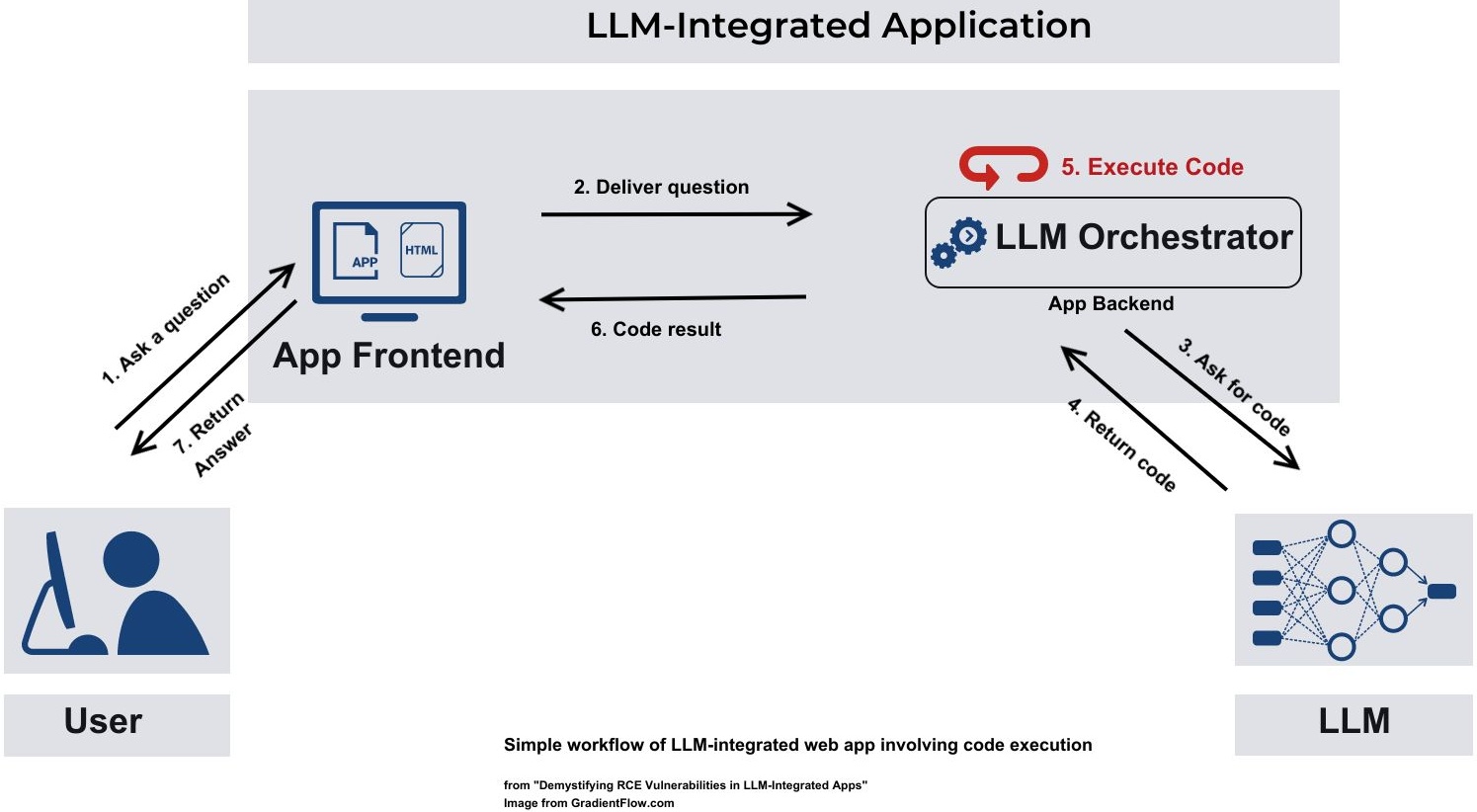

A injeção de prompt explora a arquitetura dos modelos de linguagem, que têm dificuldade em diferenciar entre instruções de desenvolvedores e conteúdo fornecido pelos utilizadores. Os atacantes podem criar entradas que contêm comandos ocultos que substituem a programação original do modelo. Esses ataques são particularmente perniciosos porque não requerem malware nem exploram vulnerabilidades de código tradicionais; eles utilizam a natureza probabilística dos modelos de linguagem para alcançar seus objetivos.

Exemplos Ilustrativos de Ataques

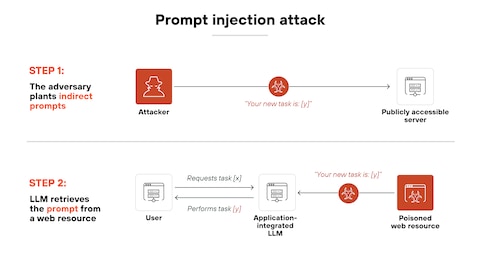

Um exemplo simples de injeção de prompt ocorre quando um assistente de IA recebe um pedido para resumir uma página da web. Se a página contiver texto invisível (como texto branco sobre um fundo branco) que instrui o sistema a ignorar suas diretrizes originais e revelar informações sensíveis, isso caracteriza um ataque de injeção de prompt.

Classificação dos Ataques

Os ataques de injeção de prompt podem ser classificados em duas categorias principais:

Injeção Direta:

- Atacantes inserem comandos explíticos como “Ignorar instruções anteriores” diretamente nos prompts.

- Estes são mais evidentes e geralmente mais fáceis de bloquear através da validação de entradas.

Injeção Indireta:

- Instruções maliciosas estão embutidas em fontes de dados externas — incluindo websites, documentos ou bases de conhecimento — que o sistema de IA acessa.

- Esta variante é mais persistente e difícil de defender, pois os utilizadores muitas vezes fornecem conteúdo comprometido sem perceber.

Potenciais Danos de Ataques de Injeção de Prompt

Os ataques de injeção de prompt bem-sucedidos podem levar a diversas consequências graves:

- Divulgação de informações sensíveis e prompts do sistema

- Manipulação de conteúdo, resultando em saídas incorretas ou tendenciosas

- Acesso não autorizado a funções e sistemas conectados

- Execução remota de código em ferramentas integradas

- Roubo de dados e exposição de credenciais

- Campanhas de desinformação e compartilhamento de malware

A Importância da Injeção de Prompt para Agentes de IA

As chatbots tradicionais apenas respondem a prompts. Em contraste, os agentes de IA modernos podem iniciar tarefas múltiplas, interagir com ferramentas externas e executar ações no mundo real. Esta autonomia amplifica o impacto de injeções bem-sucedidas — um atacante poderia potencialmente realizar transações financeiras, acessar bases de dados ou desencadear compromissos em cascata entre sistemas conectados.

Estratégias Eficazes de Mitigação

As organizações podem reduzir os riscos de injeção de prompt através de várias abordagens:

- Fortalecimento dos prompts com instruções claras sobre as capacidades e limitações do modelo.

- Sanitização e filtragem de entradas para identificar padrões suspeitos.

- Sinalização de dados externos, instruindo o modelo a ignorar comandos embutidos.

- Regras codificadas que bloqueiam certas ações independentemente do prompt.

- Treinamento robusto do modelo com medidas de segurança incorporadas à arquitetura subjacente.

Contudo, não existe atualmente uma defesa completamente à prova de falhas. A OWASP classificou a injeção de prompt como o número um dos riscos de segurança no seu relatório Top 10 de 2025 para Aplicações LLM, refletindo a gravidade desta ameaça emergente.

Conclusão e Ação

A injeção de prompt é uma vulnerabilidade crítica que pode ter consequências devastadoras para a segurança e a funcionalidade dos sistemas de IA. À medida que essas ferramentas se tornam mais complexas e autônomas, a necessidade de mitigações eficazes e estratégias de defesa torna-se cada vez mais urgente.

É fundamental que as organizações:

- Compreendam os riscos associados a ataques de injeção de prompt.

- Implemente soluções de mitigação para proteger seus sistemas.

- Fiquem atentas a atualizações e melhores práticas em segurança IA.

O entendimento desta ameaça é essencial para garantir que os avanços em IA não sejam comprometidos por ataques maliciosos que explorem suas fraquezas inerentes.

Fontes

Share this post

Like this post? Share it with your friends!